Здрастуйте, шановні читачі блогу . Зовсім недавно я писав про те, що повністю змінилася головна сторінка Мегаиндекса, з’явився новий безкоштовний хмарний хостинг з mysql від цієї компанії, а так само вони випустили SEO розширення MegaIndex Bar для ряду популярних браузерів. Ну, ось. Пертурбації тривають і розробники викотили нову добірку безкоштовних сервісів, об’єднаних під однією назвою — MegaIndex Tools.

Вообщем, моє знайомство з цією системою почалося з інтересу до інструменту «Видимість», про який я вже досить докладно писав. Потім у них ще з’явилася можливість безкоштовно аудиту свого або чужого сайта, яка мені якось навіть знадобилася. Безкоштовність і щедрість обумовлена, звичайно ж, тим, щоб залучити якомога більше користувачів до їх основного інструменту — автоматичного просування, але тим не менш скористатися ними ніщо не заважає.

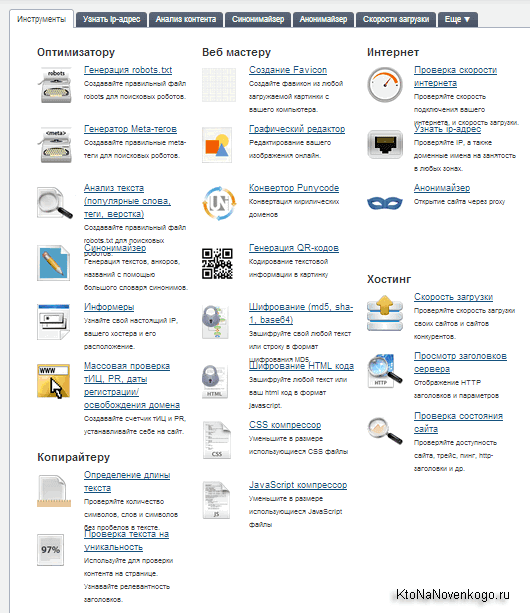

Інструменти для оптимізаторів і копірайтерів

Правда поточна новинка набагато скромніше виглядає, ніж попередні, але, по-моєму, варто згадки. Розробники спробували повторити у себе на сайті все те, що ви могли б знайти на ресурсах, які я згадував у статті про безкоштовний і швидкий аналіз сайту (Pr-cy, Cy-pr):

Інструментів досить багато, але MegaIndex Tools явно ще сируватий, бо не все працює як треба. Давайте просто пробіжимося по переліку інструментів, щоб оцінити їх корисність і функціональність:

Генерація robots.txt — файл роботс.тхт спочатку задумувався для того, щоб заборонити деяким пошукових роботів (читайте про те, як влаштовані пошукові системи) індексувати деякі частини вашого сайту. Закривають від індексації зазвичай файли движка, повні або часткові дублі сторінок, ну, і ще що-то, за розсудом вебмастера.

Google на даний момент цілком може проігнорувати прописані в robots.txt заборони, тому для гарантованого не потрапляння дублів в індекс цієї пошукової системи краще всього буде використовувати мета-тег robots, який прописується в невидимій частині Html коду веб-сторінки (між тегами Head). В WordPress я для цієї мети використовую функціонал плагін All in One SEO Pack, який заодно і канонічні сторінки вміє правильно визначати і позначати відповідним мета-тегів.

Мегаиндекс ж пропонує в своєму інструменті лише можливість заборонити або дозволити індексацію всього сайту роботами певних пошукових систем, ну, і дозволяє задати директиву Crawl-delay, яка в ідеалі вкаже цьому самому роботу максимальну частоту, з якою йому дозволено запитувати сторінки вашого сайту при індексації (для зниження створюваної на сервер хостера навантаження). Інструментарій зовсім не багатий.

Генератор мета тегів — штука прикольна, але тільки в тому випадку, якщо ви створюєте статичний сайт на Html-сторінках, які не генеруються движком сайту на льоту, а спокійнісінько лежать в папці на вашому хостингу у вигляді файликів з розширенням .html і чекають, коли до них звернеться за посиланням відвідувач вашого ресурсу (такий варіант цілком підійде для сайту візитки). В цьому випадку використовувати генератор мета-тегів буде цілком зручно для створення шапки веб сторінок.

Хоча не всі наведені там мета-теги є обов’язковими. Слід в обов’язковому порядку, звичайно ж, заповнювати title і description, вказувати кодування тексту документа (UTF 8 або Windows 1251), ну, і при необхідності закрити дану веб-сторінку від індексації через вже згаданий трохи вище мета-тег Роботс. Все інше за бажанням, але краще не засмічувати код. Отримані мета-теги потрібно буде потім вставити між відкриваючим і закриваючим Html тегами Head.

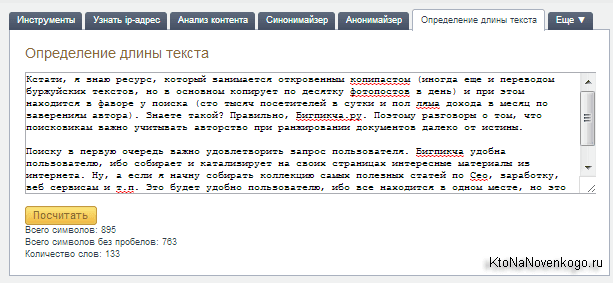

Синонімайзером — ну, це теж штука архаїчна, бо подібний автоматичний рерайт навряд чи обдурить Яндекс або Гугл. Колись давно такі речі працювали і багато просували сайти шляхом розміщення отрерайченной статті на сотнях каталогів статей. Зараз це спрацює, швидше за все, в мінус. Використовувати ж автоматичний рерайт на своєму сайті зовсім вже не варто, бо текст стає складно сприймається, а пошук все одно його буде сприймати як копіпаст.

До речі, я знаю ресурс, який займається відвертим копіпастом (іноді ще й перекладом буржуйських текстів, але в основному копіює по десятку фотопостов в день) і при цьому перебуває у фаворі у пошуку (сто тисяч відвідувачів на добу і пів ляма доходу в місяць за запевненням автора). Знаєте такий? Правильно, Бігпікча.ру. Тому розмови про те, що пошуковикам важливо враховувати авторство при ранжируванні документів далеко від істини.

Пошуку в першу чергу важливо задовольнити запит користувача. Бігпікча зручна користувачеві, бо збирає і каталізує на своїх сторінках цікаві матеріали з інтернету. Ну, а якщо я почну збирати колекцію найбільш корисних статей з Сео, заробітком, веб сервісів і т. п. Це буде зручно користувачу, бо все знаходиться в одному місці, але це буде крадіжкою (а точніше продажем краденого), т. к. заробляти на цьому буду я, а не той, хто ці статті написав.

Не можна навіть близько ставити працю копіпаста і копірайтера — останнє є в сотні разів більш трудомістким процесом. Це як порівнювати працю викрадача авто і праця його власника, який заробив потрібну суму потом і кров’ю. Причому викрадачі текстів не тільки нічим не ризикують, але і фактично заохочуються пошуком (у випадках подібних Бигпикче) на продовження протиправних дій дуже хорошим ранжируванням їх ресурсів. По-моєму, це нонсенс.

Інструменти для вебмайстрів та іже з ними

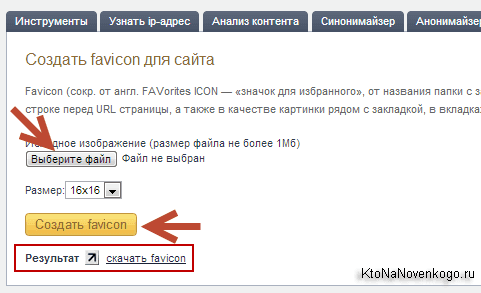

Створення Favicon — досить корисний інструмент, що дозволяє зробити з будь-якої наявної у вас картинки Фавикон — зображення 16 на 16 пікселів у форматі Ico, яка при належному підключенні до сайту (читайте в статті за наведеною посиланням) буде відображатися в списку вкладок і закладок багатьох популярних браузерів, а так само в пошуковій видачі Яндекса (має місце таке явище, як апдейт фавиконов в Яндексі і це потрібно враховувати при очікуванні появи цієї іконки у видачі навпроти вашого сайту).

Ця іконка дозволить користувачам легко виділяти ваш ресурс серед інших, як при пошуку в Яндексі, так і при роботі з вкладками та закладки у браузері. Вдала іконка підвищить відвідуваність і збільшить розміри заробітку з сайту.

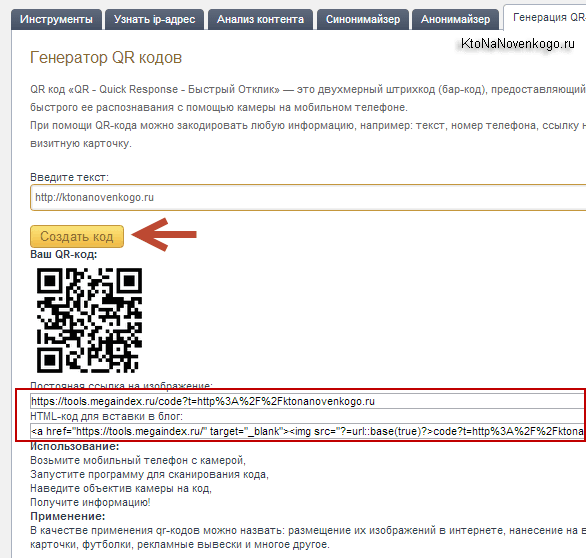

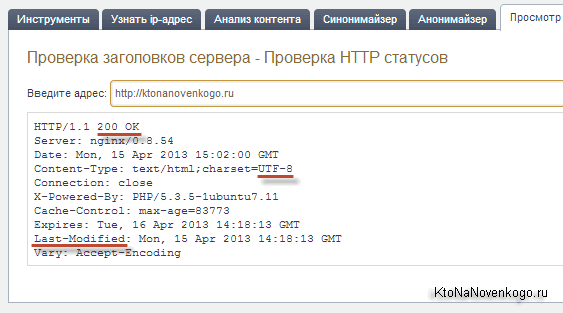

Перегляд заголовків сервера — при переході з Урлом браузер (і пошуковий робот теж, бо по суті він є найпростішим браузером) звертається із запитом до сервера, де розміщений ваш сайт (читайте про зв’язок Ip адрес, доменів та хостинг) і отримує від нього не тільки код запитуваний веб-сторінки, але і формалізований відповідь, який містить код відповіді і ще ряд супровідних параметрів (кодування тексту сторінки, дату її останнього оновлення та ін.):

Я як то вже писав про коди відповіді сервера і їх значення. Якщо коротко, то найкращий варіант — код 200, що означає наявність шуканого документа на сервері і його підвантаження в браузер. Однак, важливо щоб всі неіснуючі сторінки віддавали код 404 (ну, і користувачеві показувалася б відповідна сторінка помилки 404 — див. на приклад WordPress), а не 200, бо в цьому випадку у вас буде величезна кількість дублів.

До речі, саме з особливістю формування параметра Last-Modified (час останнього оновлення документа) пов’язаний міф про те, що статичний Html сайт краще індексується (або навіть ранжується), ніж сайт працює на ЦМС (движку). Справа в тому, що при оновленні Html сторінки на статичному сайті, сервер віддасть пошуковому боту правильне значення Last-Modified і ця сторінка буде своєчасно переіндексувати. Багато ж ЦМС не вміють толком повідомляти Last-Modified сервера і переіндексація сторінки такого сайту може бути не такою оперативною.

Удачі вам! До зустрічей на сторінках блогу